Strukturtagging – wofür das noch gut ist (Layout and beyond)

Im einem der letzten Beiträge habt Ihr gelesen, wie bei uns ein Strukturtagging durchführt wird. Wie der gesamte Werkzeugkasten des Strukturtaggings funktioniert, könnt ihr hier nachlesen. In unserem Projekt dient es v.a. dazu, ein angepasstes LA-Modell für die mixed layouts zu erstellen. Aber da steckt noch mehr Potential drin.

Wer kennt das Problem nicht?

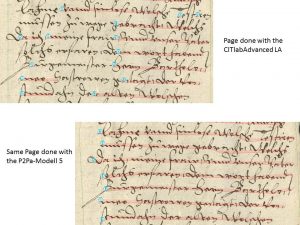

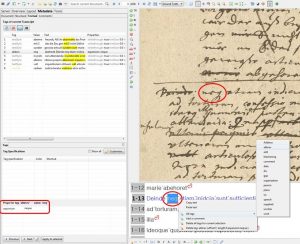

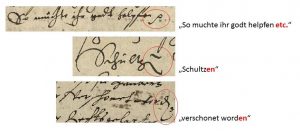

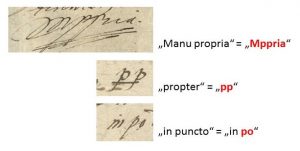

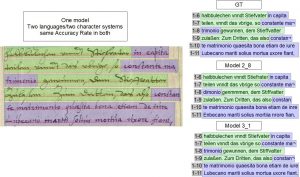

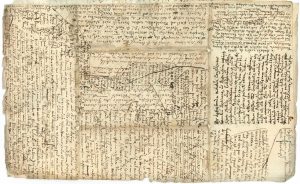

Wenn sich auf einer Seite mehrere, sehr unterschiedliche Handschriften befinden, wird es schwierig, gleichmäßig gute HTR-Ergebnisse zu bekommen. Am häufigsten kommt das vor, wenn eine ‚saubere‘ Handschrift von einem weiteren Schreiber in einer Konzeptschrift kommentiert worden ist. Hier seht ihr so ein Beispiel:

Der eigentliche Grund für das Problem ist, dass die HTR bislang ausschließlich auf der Ebene der Seite ausgeführt wird. Das heißt, ich kann die Seite oder Seiten entweder mit dem einen oder dem anderen HTR-Modell lesen lassen, aber nicht mit zwei verschiedenen, die den jeweils vorkommenden Handschriften angepasst wären.

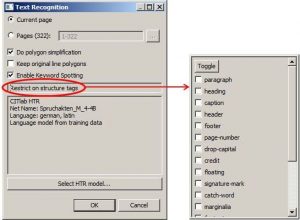

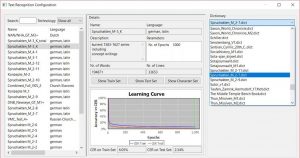

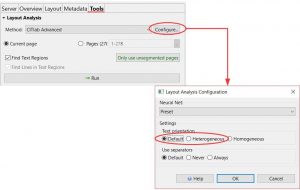

Seit Version 1.10. ist es möglich, HTR-Modelle auf der Ebene der Textregionen anzuwenden und nicht nur den Seiten zuzuweisen. Dadurch können die Inhalte einzelner spezifischer Textregionen auf einer Seite mit unterschiedlichen HTR-Modellen gelesen werden. Hier spielt das Strukturtagging eine wichtige Rolle, zum Beispiel bei Textregionen, mit vom Haupttext abweichenden Schriften. Diese erhalten einen bestimmten Strukturtag, dem wiederum ein spezielles HTR-Modell zugewiesen wird. Grund genug also, sich mit Strukturtagging auseinander zu setzen.